El Consejo de Redacción de EFE reprende a la IA de Elon Musk tras difundir información falsa

La irrupción de la inteligencia artificial en el ámbito informativo vuelve a encender las alarmas sobre la veracidad y el control de los datos difundidos en redes sociales. El último episodio involucra a Grok, la inteligencia artificial desarrollada por la plataforma X —anteriormente Twitter—, propiedad de Elon Musk.

Confusión en un contexto de conflicto internacional

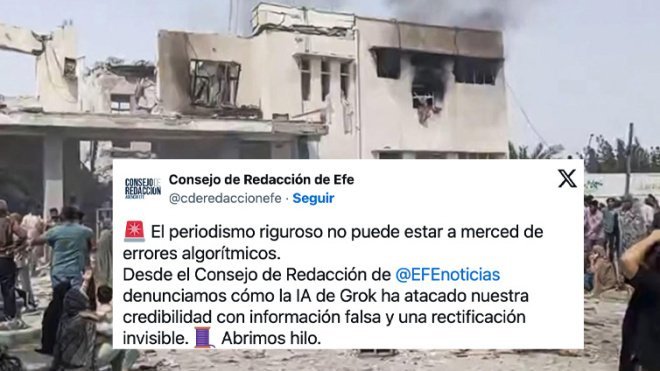

Los hechos ocurrieron este domingo, cuando la Agencia EFE publicó imágenes de una escuela de niñas bombardeada en Irán durante un ataque atribuido a Israel, que según fuentes oficiales ya ha causado al menos 148 víctimas mortales. Ante la difusión de estas imágenes, varios usuarios de la red social X consultaron a Grok, la IA de la plataforma, sobre su procedencia.

La respuesta de Grok fue categórica: afirmó que las imágenes correspondían en realidad a un atentado ocurrido en Kabul en 2021. Sin embargo, la Agencia EFE desmintió esta información aportando pruebas sólidas, como la geolocalización de las imágenes y comparativas con fotografías satelitales, que confirmaban la autenticidad del material publicado.

Rectificación poco visible y preocupación en el sector

El Consejo de Redacción de EFE no tardó en reaccionar. A través de la propia red social X, la agencia expuso públicamente el error cometido por la inteligencia artificial y criticó la escasa visibilidad que tuvo la posterior rectificación por parte de Grok. Según la agencia, mientras la mentira se difundió con rapidez, la corrección apenas alcanzó el mismo nivel de alcance.

- La IA de Grok reconoció su equivocación tras ser confrontada con pruebas.

- La visibilidad de la rectificación fue considerablemente menor que la de la información errónea.

- El Consejo de Redacción de EFE insiste en la necesidad de verificar siempre la información, incluso cuando proviene de sistemas automatizados.

Implicaciones para el periodismo y la opinión pública

Este incidente plantea serias interrogantes sobre el papel de la inteligencia artificial en la difusión de noticias, especialmente en contextos de conflicto y desinformación. La rapidez con la que las IAs pueden propagar datos incorrectos —y la dificultad para revertir su impacto— representa un desafío adicional para los medios de comunicación y la sociedad en general.

La situación se agrava si se considera el entorno político, ya que el conflicto en cuestión involucra a gobiernos con intereses globales y al propio Elon Musk, conocido por su apoyo al expresidente estadounidense Donald Trump. El caso refuerza la importancia de mantener la labor periodística basada en la verificación rigurosa y la responsabilidad informativa, frente a la creciente influencia de las plataformas tecnológicas y sus algoritmos.

El reto de la información en la era de la IA

El Consejo de Redacción de EFE alerta sobre los riesgos de confiar ciegamente en sistemas de inteligencia artificial para la obtención de información veraz. En un momento en el que la plataformización del periodismo ya ha reducido la autonomía de los medios frente a grandes corporaciones tecnológicas, la IA podría suponer un nuevo desafío para la integridad informativa.

Este caso subraya la necesidad de promover el pensamiento crítico y la verificación de los hechos como elementos centrales en el consumo de noticias, especialmente cuando la inteligencia artificial entra en juego en el debate público.

Nota:

Los contenidos publicados en este sitio han sido generados y/o reelaborados mediante el uso de herramientas de inteligencia artificial.

elpuebloinforma.com declina toda responsabilidad, directa o indirecta, por eventuales errores, inexactitudes, omisiones u otras irregularidades presentes en los textos.

El usuario reconoce que dichos contenidos tienen exclusivamente fines informativos y no pueden sustituir en ningún caso fuentes oficiales ni asesoramientos profesionales.